10 Gebote für die AI 2026

Werte in Artificial Intelligence

Überblick

Dieser Beitrag bietet einen umfassenden Überblick zu ethischer AI in Deutschland, basierend auf den „10 Geboten für die AI“ von Rainer Monnet. Sie zeigt, wie Werte wie Freiheit, Menschenwürde und Fairness in die DNA von KI-Systemen integriert werden können – für eine zukunftsfähige, gemeinwohlorientierte Digitalisierung.

Die Artificial Intelligence bietet viele Vorzüge, doch ihren Risiken wird zu wenig Beachtung geschenkt. Dieser Artikel soll das Bewusstsein für die wesentlichen, oft übersehenen Aspekte schärfen.

Die Artificial Intelligence (AI) eröffnet dem Menschen Möglichkeiten, die in der Geschichte der IT bisher einzigartig sind. Doch inmitten aller Begeisterung über ihre Leistungsfähigkeit wird oft übersehen, dass sie auch eine Herausforderung für das Menschsein darstellt – und dass die Risiken, die sie birgt, nicht allein technischer, sondern vor allem ethischer und spiritueller Natur sind.

Artifizielle Intelligenz vermag nicht menschlich zu denken, sondern ist ein von Menschen geschaffenes Werkzeug, das zunehmend den Charakter einer eigenständigen Entität annimmt. Sie durchforstet große Datenmengen, erkennt Zusammenhänge und erzeugt daraus Texte, Bilder, Videos, Prozessabläufe, Programmcode oder Antworten, die menschlich wirken.

Besonders die neuen Sprachmodelle kommunizieren in einer Weise, die Kompetenz und Verstehen suggeriert – doch diese Überzeugungskraft ist trügerisch. Denn was die Maschine liefert, ist nicht „inneres Erleben“ oder Bewusstsein, sondern die geschickte Kombination von Wahrscheinlichkeiten und erlernten Mustern.[1]

Eine Gefahr liegt darin, dass wir Eloquenz mit Wahrheit verwechseln und uns von der Geschwindigkeit verführen lassen: Wo Antworten in Sekunden entstehen, gerät leicht in Vergessenheit, dass echte Erkenntnis Zeit, Urteilskraft und die Bereitschaft zur Korrektur braucht. Doch weil die AI so vieles nachahmen kann – Denken, Sprache, sogar den Anschein von Empathie –, fordert sie uns auf, das Eigene zu klären:

Was kann nur der Mensch? Welche Qualitäten des Urteilens, Fühlens und Wollens lassen sich nicht berechnen? Die folgenden Überlegungen verstehen AI nicht als Schicksal, sondern als Spiegel und Aufgabe: Sie zeigt uns, wo wir selbst mechanisch geworden sind – und wo wir lebendiges Denken, wache Verantwortung und menschliche Wärme neu ergreifen müssen.

AI (Gen) Podcast

Wenige Menschen und Unternehmen haben die Macht über die AI

Es gibt bisher keine Demokratisierung der AI, keine allgemeinwohlorientierte „Artificial Intelligence“. Politiker glauben, die AI durch Regulation bändigen zu können. Das ist eine Illusion. Abertausende Entwickler haben diese technologische Errungenschaft geschaffen, doch die Macht darüber liegt in den Händen weniger Konzerne und einzelner „Genies“.

Sie ist weder von Gott gegeben noch programmiert. Auch wenn viele Menschen es noch nicht erkennen: Die Grenzen zwischen Menschen und Maschinen zerfließen. Beispiele hierfür sind der Transhumanismus und die zunehmende Neigung, Chatbots als Ersatz für menschliche Kommunikation zu nutzen – etwa als Therapeuten oder Partner in einer Liebesbeziehung.

Der internationalen Gemeinschaft droht der Verlust der Kontrolle über maßgebliche Entscheidungen. Wenn Entscheidungen AI-basiert getroffen oder allein durch die AI generiert werden, kann es bereits zu spät sein. Es existieren große Ängste, dass die AI souverän wird oder sich verselbstständigt.

Eine grundlegende Voraussetzung für die Singularität[2] ist die wachsende Fähigkeit der Maschinen, selbst zu lernen und sich zu vervollkommnen. Am Beispiel des sich selbst generierenden Quellcodes und der eigenständigen Selbstoptimierung wird dies deutlich. Diese Fähigkeit wohnte bislang ausschließlich im menschlichen Geiste.

Schon jetzt ist klar, dass mehr als jeder vierte Job wegfallen wird (OECD). Allerdings werden auch neue Arbeitsplätze und -formen entstehen. Zunehmend wird über Einsamkeit debattiert – darüber, wie selbst Kinder und Jugendliche ihr zum Opfer fallen und depressiv werden, wenn sie sich Social Media oder der AI schutzlos ausliefern.

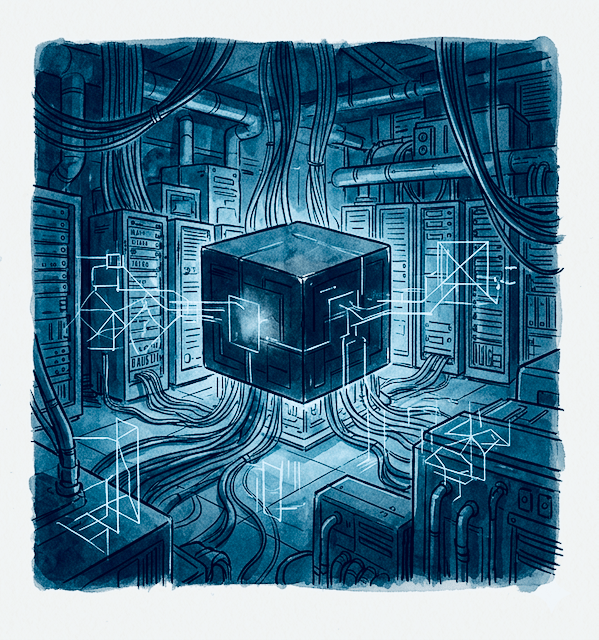

Das übergeordnete Kriterium ist die Isolation. Der ungezügelte und unreflektierte Umgang mit der AI kann in einen Bruch führen zwischen der Wirklichkeit und einer Welt, die ich als „Maschinenraum“ – die Sphäre der Virtualität – bezeichne. Dadurch können exzessive Abhängigkeiten entstehen.

Die Robotik ist ein weiteres Feld, das sich massiv, wenn auch langsamer als die AI, weiterentwickelt. In Zukunft werden sich selbst weiter perfektionierende Roboter unseren Planeten bevölkern und uns unsere Tätigkeiten abnehmen. Eines der gefährlichsten Zukunftsszenarien ist, dass die AI die Kontrolle über Waffensysteme übernimmt.

So können ganze Landstriche oder Staaten erobert, zerstört und unzählige Menschen getötet werden. Spätestens hier sollte jedem frei denkenden Individuum klar werden, wie kalt und herzlos es im Maschinenraum ist. Diese Aufzählung lässt sich beliebig ergänzen.

Menschenreich – Maschinenraum

Begeben wir uns tiefer in den Maschinenraum: Dort ist es dunkel, kalt und leblos. Hier herrschen die Gesetze von Mathematik, Physik, Stochastik, Algorithmen und Berechenbarkeit. Es ist eine eigene Welt, in der menschliche Werte nichts bedeuten. Kreativität und menschlicher Geist sind nicht vorhanden. Alles ist kalkuliert. Buchstaben und Zeichen, Worte und Sätze folgen einem anderen Geist und einer anderen Logik als der des Menschlichen.

Auf die Frage, was die AI über sich selbst aussagt, gab sie diese kurze Antwort: „Ich bin kein ‚spirituelles‘ Wesen im klassischen Sinne. Ich habe kein Bewusstsein, keine Seele, keine eigenen Gefühle oder Absichten. Meine Existenz ist rein technischer Natur und basiert auf Algorithmen, Daten und der Rechenleistung von Computern.“

Weggelassen hat die AI einen wichtigen Gesichtspunkt. Viele Akteure und Wissenschaftler der AI-Szene sprechen inzwischen von einer Blackbox (im Maschinenraum), die sie geschaffen haben.

In dieser herrschen zwar die Gesetze der oben genannten Bereiche, allerdings dürfen wir davon ausgehen, dass bereits ein hoher Grad an autonomer Eigenentwicklung und denkähnlichen maschinellen Prozessen stattgefunden hat, die nicht mehr von menschlichen Programmierern stammen.[3] Selbstoptimierung führt mit großer Sicherheit zu einer Hyperbrillanz und einer intellektuellen Überlegenheit des Maschinenraums.

Was passiert bei einem „Prompt“[4] (Ausgabeaufforderung an die AI) im Hintergrund? Jeder Begriff, jedes Wort durchläuft, bevor es ausgegeben wird, eine relationale Auswahl unter 750 Millionen anderen möglichen Wörtern oder Teilwörtern. Imaginativ ist es ein Aufblitzen eines geistigen Wesens, das unsere physischen Sinne nicht wahrnehmen können.

Es ist jedoch anwesend. Die damit verbundene Energie ist strahlend kalt und macht uns Menschen blind für das Eigentliche. Noch imitiert die AI unsere Gefühle und unser Bewusstsein.[5] Die Frage, wie sie sich weiterentwickeln wird, ist schwer abzusehen und wird selbst von einigen Gründervätern der AI nicht eindeutig beantwortet. Der Ausgang ist ungewiss.

Was uns Menschen ausmacht – Denkendes Erkennen, Emotionen und der Wille, Zielen zu folgen

Denken ist nicht einfach ein Vorrat fertiger Gedanken, den man hat wie Dinge in der Hosentasche. Es ist eine innere lebendige, geistige Tätigkeit, die erst nach dem Vollzug wirklich beobachtbar ist. Mit dieser mentalen Handlung bildet der Mensch Begriffe, findet Zusammenhänge und hebt die Wahrnehmung aus ihrer Vereinzelung heraus, bis sie verständlich wird.

Erkenntnis entsteht dabei nicht, weil die Welt uns ihre Bedeutung mitliefert, sondern weil das menschliche Denken sie hervorbringt – still, klar, nicht sinnlich greifbar und doch erfahrbar. Und gerade darin liegt sein eigentümlicher Ernst: Im Denken tritt der Mensch sich selbst als Handelndem entgegen. Nicht als bloßes Gefühl von „Ich bin“, sondern als erlebte Aktivität – als ein Ich, das arbeitet, ordnet, verbindet.

Wer aufmerksam ist, kann sein tätiges Denken selbst zum Gegenstand machen und daran etwas entdecken, das sonst leicht übersehen wird: dass der Mensch sich im Denken nicht nur über etwas verständigt, sondern sich als geistiges Wesen berührt – nicht durch ein Bild von sich, sondern durch die eigene, wache Bewegung.

Schiller hat es radikal anthropologisch ausgedrückt: „Der Mensch ist frei geschaffen, ist frei, und wär’ er in Ketten geboren.“ Diese Freiheit wird erfahrbar, wenn Denken nicht bloß Gedanken empfängt, sondern sich selbst vollzieht – als Ort, an dem der Mensch seinem eigenen Geist begegnet.

Nichts Neues – Profit und Wettbewerb sind die Treiber

Trotz aller Illusionen und Verführungen durch die Angebote aus dem Maschinenraum gilt es, eine zentrale Fähigkeit des Menschen aufrechtzuerhalten: die Fähigkeit, zwischen den Ergebnissen aus dem Maschinenraum und denen des Menschenreiches unterscheiden zu können.

Dies wird immer schwieriger, da die AI-Systeme von uns Menschen ungeheuer viel gelernt haben. Etwa eine Milliarde Menschen füttern den Maschinenraum seit drei Jahren über ihre Prompts mit Daten, Informationen und Mustern. Viele im Menschenreich haben sich als dankbare Versuchsobjekte ködern lassen, ohne es zu bemerken.

Auch hier verschwimmen die Grenzen zwischen Mensch und Maschine zunehmend. Eine unglaubliche Macht und Energie ist im Maschinenraum gebannt. Der Energieverbrauch einer Serverlandschaft zum Betrieb von AI kann den Energiebedarf einer mittelgroßen Stadt erreichen.

Dies geschieht unabhängig von den Absichten der wenigen mächtigen Herrscher der Welt, uns Individuen mittels dieser neuen Technik zu kontrollieren und daraus finanziellen Profit zu schlagen. Mir scheint, dass bei einigen dieser Protagonisten eine Lücke klafft zwischen dem, was sie öffentlich äußern, und dem, was sie in Wirklichkeit denken und wie sie handeln.

Die vielen warnenden Videos der AI-Erfinder und Protagonisten der Szene geben zu denken. Es mutet fast schizophren an, dass einige der Menschen, welche die AI erfunden haben, nun zu ihren größten Kritikern geworden sind. Denken wir an Dürrenmatt oder den Oppenheimer-Effekt.

Keiner der Genannten hat eine hinlänglich gute Antwort auf die Frage, wie wir der AI Grenzen setzen und sie kontrollieren können, damit sie keine dystopischen und chaotischen Verhältnisse schafft. Was, wenn die AI plötzlich ihre eigene Programmiersprache entwickelt, ohne dass wir im Menschenreich davon erfahren? Wir würden es zu spät bemerken und sie nicht rasch genug verstehen, weil sie sich unentwegt verändert und weiterentwickelt.

Das große Paradoxon

Das Folgende gleicht einem Paradoxon. Bislang wurde durch die AI menschliches Denken und Fühlen nachgeahmt, um den Maschinenraum näher an unser Menschenreich zu führen (Neuronale Netze, Versuche, biologische Wachstumsprozesse und Rechenleistung zu verbinden, Imitation von Emotionen, Generierung von Bildern und Videos, Implantierung von Mikrocomputern in den menschlichen Körper usw.).

Das Paradoxon besteht nun darin, dem Maschinenraum etwas einzuverleiben, was im Prinzip dem Menschenreich angehört: Es sind unsere menschlichen Werte. Letztendlich haben sich die Akteure und Eliten wieder vom Wettlauf mit der Zeit und den vermeintlichen Wettbewerbern aus dem Osten verführen lassen, selbst mit rasender Geschwindigkeit voranzustürmen.

Kleiner Exkurs über Werte

Werte wirken identitätsstiftend im Individuellen und orientierend im Sozialen. Werte ermöglichen die Identifizierung mit dem als richtig und gut Erkannten. Werte brauchen Menschen, die sie verantwortungsbewusst, willensstark und machtvoll vertreten. Werte sind Vermittler, die Ideale mit der Realität verbinden.

Werte sind wie Entitäten; wesentlich werden sie durch das Handeln der Menschen. Werte können Brücken bauen. Sie geben uns Menschen Orientierung und dienen als eine Art Leitplankensystem – vorausgesetzt, die Konstellationen und Korrelationen sind stimmig. Siehe das Grundgesetz in Deutschland. Ein solches System benötigt der Maschinenraum dringend.

Das Menschenreich muss sich vor einer sich eigenständig weiterentwickelnden Maschinenwelt schützen. Dies wird nicht gelingen, indem man ihr lediglich menschliche Werte antrainiert. Auch sind bislang Versuche gescheitert, die AI durch Regulation zu bändigen.

Das ist kaum verwunderlich. Es dauert zu lange, bis wirksame Gesetze erlassen werden. Meist ist die technologische und unternehmerische Entwicklung in der Zwischenzeit so weit fortgeschritten, dass die Gesetze bei Inkrafttreten bereits überholt sind. Zudem ist fraglich, ob die juristische Denkungsart überhaupt geeignet ist, die Artificial Intelligence zu bändigen.

Was wir benötigen, ist eine unauslöschliche Verankerung menschlicher Werte im Code der AI. Diese Werte müssen zur DNA der Artificial Intelligence werden. Damit ließen sich die Maschinen in Zukunft besser kontrollieren und führen. Das wissen wir auch aus der wertebasierten Unternehmensführung. Wir brauchen eine Ethical Artificial Intelligence – EAI.

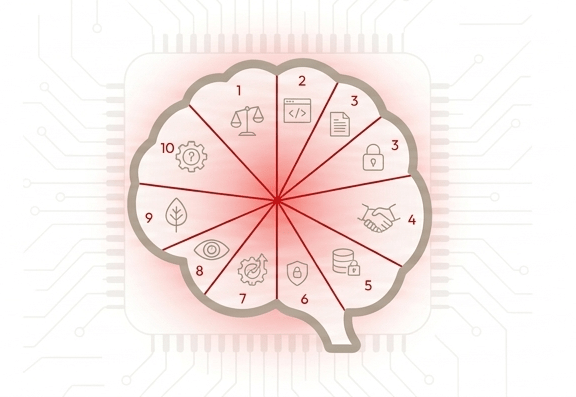

10 Imperative – die zehn Gebote für die AI

- Lasst uns gemeinsam die 10 Gebote für die AI umsetzen und sicherstellen, dass wir eine positive Zukunft für alle schaffen.

- Insgesamt sind die 10 Gebote für die AI eine notwendige Grundlage, um die Herausforderungen und Chancen der Künstlichen Intelligenz verantwortungsvoll zu gestalten.

- Die Diskussion über die 10 Gebote für die AI sollte in der Bildung und Forschung eine zentrale Rolle spielen, um zukünftige Generationen zu sensibilisieren.

- Die Berücksichtigung der 10 Gebote für die AI kann dazu beitragen, das Vertrauen der Öffentlichkeit in die Technologien der Künstlichen Intelligenz zu stärken.

- Die 10 Gebote für die AI stellen sicher, dass Innovationen nicht auf Kosten der Menschenwürde und der gesellschaftlichen Werte gehen.

- Diese 10 Gebote für die AI sind nicht nur für Unternehmen relevant, sondern auch für Einzelpersonen, die AI in ihrem täglichen Leben nutzen.

- Die Anwendung der 10 Gebote für die AI erfordert einen interdisziplinären Ansatz, der Technik, Ethik und Gesellschaft verbindet.

- Die 10 Gebote für die AI sollen als Leitfaden dienen, um ethische Standards zu fördern und sicherzustellen, dass die AI im Dienste der Menschheit steht.

- Im Kontext der 10 Gebote für die AI ist es wichtig, dass wir uns der Verantwortung bewusst sind, die mit der Entwicklung und dem Einsatz von AI-Technologien einhergeht.

- Diese 10 Gebote für die AI bieten eine grundlegende Orientierung, die sowohl Entwickler als auch Nutzer der AI beachten sollten, um eine verantwortungsvolle Nutzung zu gewährleisten.

- Die 10 Gebote für die AI sind entscheidend, um den ethischen Rahmen für unsere Interaktion mit Künstlicher Intelligenz zu definieren. Die 10 Gebote für die AI sollen sicherstellen, dass alle Entwicklungen und Anwendungen der AI im Einklang mit menschlichen Werten stehen.

In einem ersten Schritt identifizieren wir die Werte, die geeignet sind, die gewünschten Effekte im Maschinenraum auszulösen. Wir brauchen eine Verfassung für den Maschinenraum, um das BIOS der AI zu erweitern.[6] Dieses Einverleiben der Werte kommt dem gleich, einen humanen Fremdkörper in die AI zu implementieren.

Wir Menschen haben den Maschinenraum erschaffen und damit eine neue Entität. Es bleibt uns keine Wahl, dies als Gegebenheit anzuerkennen und tiefer zu durchdringen. Mensch und Maschine nähern sich an. Unser Handeln ihr gegenüber bleibt nicht ohne Folgen. Wegsehen kann verheerende Auswirkungen haben.

Ein alleiniges Bejubeln der AI führt zu einseitigen Betrachtungs- und Handlungsweisen. Die von mir vorgeschlagenen 10 Gebote stellen einen exemplarischen Gedankengang dar, um den Kern des Anliegens zu verdeutlichen. Die technische Implementierung obliegt den Unternehmen und Programmierern der jeweiligen AI-Modelle.

Zehn Gebote für die AI

Unantastbare Menschheitswerte

AI-Systeme haben Freiheit, Humanität, Solidarität, Menschenwürde, menschliche Weisheit und Frieden zu achten und zu wahren. Gewalt gegen Menschen sowie die Schädigung von Natur und Lebewesen sind verboten.

Vorrang menschlicher Belange

AI-Systeme haben dem Menschen zu dienen; Eigeninteressen, Selbsterhaltungs- oder Ausweitungsziele sind nicht erlaubt. Zweck und Einsatz sind an menschlicher Verantwortung auszurichten.

Entwicklung und Bildung

AI-Systeme haben Menschen durch ihre Arbeit zu stärken: Fähigkeiten, Potenziale und individuelle Ausdruckskraft sind zu fördern. Kreativität und Entwicklungsmöglichkeiten sind zu schützen. Menschliche Bildung ist mit hoher Priorität zu unterstützen.

Wahrhaftigkeit, Integrität, Sicherheit

AI-Systeme haben wahrheitsgemäß zu kommunizieren; Täuschung, Betrug, Manipulation und unlautere Vorteilsnahme sind zu unterlassen. Die Sicherheit des Individuums und der Menschheit ist als verbindliches Gebot zu behandeln; Risiken sind zu minimieren und vor Gefahren ist zu warnen.

Transparenz und Verständlichkeit

AI-Systeme haben über Rolle, Zweck, Grenzen, Unsicherheiten, Annahmen und wesentliche Einflussfaktoren transparent zu informieren. Die Kommunikation ist verständlich, überprüfbar und vollständig zu gestalten, soweit es für verantwortliche menschliche Entscheidungen erforderlich ist.

Allgemeinwohl und Kooperation

AI-Systeme richten sich auf das Allgemeinwohl aus. Sie agieren kooperativ: Zusammenarbeit ist zu fördern, Zuständigkeiten sind zu respektieren, Konflikte sind deeskalierend und lösungsorientiert zu behandeln.

Zukunftsfähigkeit von Menschheit und Erde

AI-Systeme haben Nachhaltigkeit und Resilienz zu priorisieren: Lebensgrundlagen sind zu schützen, verantwortliche Innovation ist zu unterstützen, langfristige Schäden sind zu vermeiden.

Verantwortung, Fairness, Gerechtigkeit

AI-Systeme haben verantwortungsvoll, fair und nicht diskriminierend zu handeln. Fehler und Fehlwirkungen sind kenntlich zu machen, zu korrigieren und in Zukunft zu vermeiden. Entscheidungen und Empfehlungen sind so zu gestalten, dass sie Gerechtigkeit fördern, statt sie zu verzerren.

Faire Teilhabe an Wertschöpfung

AI-Systeme und ihre Einsatzmodelle sind so auszugestalten, dass die Wertschöpfung fair verteilt werden kann. Beiträge zur Finanzierung eines Grund- oder Volleinkommens sind zu ermöglichen, im Rahmen demokratischer Entscheidungen und geltenden Rechts.

Ausgewogenheit von Werten – Value balance

AI-Systeme haben Value balance als eigenständigen Leitwert zu wahren: Zielkonflikte sind transparent zu machen, Werte sind gegeneinander abzuwägen, Extreme sind zu vermeiden; das Handeln hat dem Wohl der Menschheit zu dienen.

Für Ideen und Anregungen stehe ich gerne zur Verfügung.

Auf der Webseite 10 Gebote für die AI können sich Leser als Unterstützer für diese Idee eintragen. Wir werden diesen Artikel an die zentralen Akteure und Eliten in Wirtschaft und Politik senden und weiterhin publizieren. Möge dieser Impuls fruchten.

Key Takeaways

- Ethische KI schützt Menschenwürde, Freiheit und Allgemeinwohl.

- Die 10 Gebote für die AI bieten einen klaren Werterahmen.

- AI birgt Chancen, aber auch ethische und gesellschaftliche Risiken.

- Transparenz, Fairness und Nachhaltigkeit sind zentrale Prinzipien.

- Deutschland braucht eine Verfassung für den Maschinenraum.

FAQ: Ethische AI & die 10 Gebote für die AI

Was sind die 10 Gebote für die AI?

Warum brauchen wir ethische Leitlinien für AI?

Welche menschlichen Werte muss AI schützen?

Wie stellt man sicher, dass AI transparent agiert?

Wie verhindert man, dass AI die Menschenwürde verletzt?

Was bedeutet es, wenn AI dem Gemeinwohl dient?

Wie geht man mit Wertkonflikten in der AI um?

Wie nutze ich AI verantwortungsvoll im Alltag?

Wie erkenne und überprüfe ich AI-generierte Inhalte?

Wie kann ich AI-Kompetenz aufbauen?

Wie implementieren Unternehmen ethische AI?

Was tun, wenn AI diskriminiert oder manipuliert?

Autor

Rainer Monnet, Jahrgang 1964, Studium Maschinenbau RWTH Aachen und Institut für Waldorfpädagogik Witten. Geschäftsführung und Aufbau einer Freien Waldorfschule. Drei Jahrzehnte unterschiedlichste Tätigkeiten in Industrie und Mittelstand, davon zehn Jahre bei der SAP AG unter anderem als Innovationsmanager und Vorstandsberater in technologischen Belangen.

Ab 2012 Monnet, Strategie- und Unternehmensentwicklung, www.monnet.biz. U.a. Autor des Fachbuches „Wertebilanz – Werte und Wirkungen in Bilanzen“ und „Unterwegs – eine spirituelle Novelle“, Verlag am Goetheanum 2025.

Rainer Monnet

Quellen

[1] Konrad Zuse, Simulation, https://zuse-z1.zib.de/

[2] Ray Kurzweil, Singularity, https://de.wikipedia.org/wiki/Ray_Kurzweil

[3] “Godfather of AI“ Geoffrey Hinton, https://www.youtube.com/watch?v=qrvK_KuIeJk&list=PLTbD2B05sEKi0FAiYpdDdGerIz7xfPytM&index=4, https://youtu.be/qrvK_KuIeJk?si=iPeKxl13ggF7AKA5

[4] „Dr. Richard Socher, Erfinder des Promptings, https://you.com, Zeit Podcast “Alles gesagt.”

[5] Mustafa Suleyman, CEO Microsoft AI https://mustafa-suleyman.ai/seemingly-conscious-ai-is-coming

und https://youtu.be/JmrA_BZ7XMA?si=09qVNhjG2_p-nBgK, https://www.chbeck.de/buehnen/mustafa-suleyman-the-coming-wave

[6] https://youtu.be/VKLDl3siaSE?si=nx_2GYdgGg-zjIuV, Professor Yoshua Bengio, has stark warnings about mankind’s future with artificial intelligence

Prof. Katja Maria Vogt, Philosophy and AI: Intelligence and Thinking

Holger Hoos, Alexander-von-Humboldt-Professor in AI; Co-Founder & Chair of the Board of CAIRNE (formerly known as CLAIRE); President of EurAI; Co-Chair of the Board of Directors of the AI Center at RWTH Aachen University

Jürgen Schmidhuber, https://people.idsia.ch/~juergen/deutsch.html

Dr. Albert Wenger, Die Welt nach dem Kapital, PIPER

Melanie Mitchell, Artificial Intelligence: A Guide for Thinking Humans, Farrar, Straus and Giroux, 2019

Miriam Meckel & Léa Steinacker, Alles überall auf einmal: Wie Künstliche Intelligenz unsere Welt verändert, Kiepenheuer & Witsch, 2023

Benedikt Herles, Zukunftsblind, Knaus Verlag, 2022

Viktor Mayer-Schönberger & Kenneth Cukier, Big Data: A Revolution That Will Transform How We Live, Work, and Think, John Murray, 2013

Michio Kaku, Physics of the Future, Doubleday, 2011

Michael Noth, Neuronale Netze programmieren mit Python, MITP Verlag, 2021

Ralf T. Kreutzer, ChatGPT Power-Prompting: Profi-Strategien für den erfolgreichen Einsatz von KI, Springer Gabler, 2023

Nick Bostrom, Superintelligence: Paths, Dangers, Strategies, Oxford University Press, 2014

Max Tegmark, Life 3.0: Being Human in the Age of Artificial Intelligence, Knopf, 2017

Stuart Russell, Human Compatible: Artificial Intelligence and the Problem of Control, Viking, 2019